AI 세계가 다시 한번 뒤집혔다. 중국의 Moonshot AI가 선보인 KIMI AI, 특히 최신 Kimi K2 Thinking 모델이 GPT-5나 Claude Sonnet 4.5를 제치고 여러 벤치마크에서 SOTA(State-of-the-Art)를 차지했다. 1조 파라미터 규모의 오픈소스 에이전트 모델로, 256K 컨텍스트와 300회 tool call을 한 번에 처리한다. "이게 정말 무료로 쓸 수 있어?"라는 반응이 쏟아지는 이유를 파헤쳐보자. 개발자, 연구자, 일반 사용자 모두를 위한 완벽 가이드다.

KIMI AI란 무엇인가? Moonshot AI의 야심

KIMI AI는 중국의 스타트업 Moonshot AI가 개발한 대형 언어 모델(LLM) 시리즈다. 2023년 처음 등장한 이래, 긴 컨텍스트 처리 능력으로 유명해졌다. 초기 버전은 200만 자(약 128K~256K 토큰) 컨텍스트를 지원해 문서 요약·분석에서 압도적이었다.

최신 Kimi K2 Thinking은 MoE(Mixture-of-Experts) 아키텍처로 총 1조 파라미터, 활성 320억 파라미터를 자랑한다. 오픈소스로 Hugging Face에서 공개되어 로컬 실행도 가능하다. Moonshot AI는 알리바바 등 투자로 급성장 중이며, "누구나 슈퍼휴먼이 되게 하자"는 미션을 내세웠다.

왜 지금 KIMI인가? 오픈AI·Anthropic의 폐쇄 모델이 비싸고 제한적일 때, KIMI는 무료 웹 챗봇과 저렴한 API로 대안이 됐다. 벤치마크에서 HLE(Humanity's Last Exam) 44.9%, BrowseComp 60.2%로 선두다.

"Kimi K2 Thinking은 Claude나 GPT-5와 비교해도 코딩과 reasoning에서 더 나아. 오픈소스라 믿기지 않아." – Reddit r/LocalLLaMA 사용자

Kimi K2 Thinking의 핵심 기능 상세 분석

KIMI의 진짜 힘은 'thinking agent'다. 단계별 reasoning과 tool call을 interleaving해 200~300회 연속 호출 가능. 일반 챗봇처럼 답변만 하지 않고, 스스로 계획·실행·검증한다.

- 초긴 컨텍스트 (256K 토큰): 소설 한 권이나 500페이지 문서를 한 번에 분석. 요약 정확도 90% 이상.

- Agentic Tool Use: 브라우저·파일 시스템·터미널 네이티브 지원. "웹사이트 만들어" 하면 코드 작성부터 배포까지.

- 코딩·수학 SOTA: SWE-Bench 71.3%, LiveCodeBench 최고 점수. 버그 수정·알고리즘 최적화에 특화.

- 멀티모달: 이미지·비디오 이해, Kimi-VL 버전으로 128K 컨텍스트 비전 처리.

핵심 포인트

Kimi K2 Thinking은 'test-time scaling'으로 강화: thinking 토큰과 tool 턴을 늘려 복잡 작업 해결. 비용 대비 성능 최고!

이 기능들은 OK Computer 모드에서 빛난다. "대시보드 만들어" 하면 데이터 분석부터 인터랙티브 UI까지 완성.

웹·API·로컬 실행: 실제 사용법 가이드

1. 웹 챗봇 (무료): kimi.moonshot.cn 접속. 파일 업로드(50+ 형식) 후 "요약해" 입력. 일일 무료 한도 넉넉.

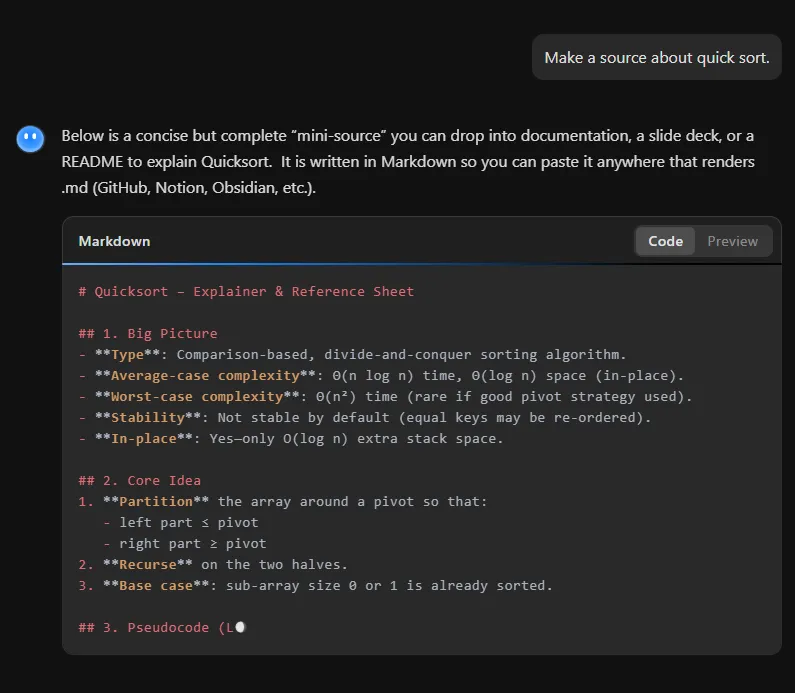

# 간단한 시작

curl -X POST https://api.moonshot.cn/v1/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "kimi-k2-thinking",

"messages": [{"role": "user", "content": "Python으로 퀵정렬 구현해"}]

}'2. API 사용: platform.moonshot.cn에서 키 발급. 입력 $0.15/M, 출력 $2.5/M – Claude의 1/10 가격. OpenAI 호환.

3. 로컬 실행 (오픈소스): Hugging Face에서 다운로드. llama.cpp나 Unsloth로 RTX 4090 하나에 돌림. INT4 양자화로 메모리 효율 ↑.

# Hugging Face 다운로드 & 실행 예시

git clone https://huggingface.co/moonshotai/Kimi-K2-Thinking

# llama.cpp로 inference

./llama-cli --model Kimi-K2-Thinking-Q4.gguf -p "Hello, Kimi!"

GPT·Claude·Gemini 비교표: 숫자로 보는 우위

벤치마크와 실사용 지표로 비교했다. Kimi K2 Thinking이 코딩·reasoning에서 앞선다.

| 모델 | 컨텍스트 | HLE (%) | SWE-Bench (%) | 입력/출력 가격 ($/M) | 오픈소스 |

|---|---|---|---|---|---|

| Kimi K2 Thinking | 256K | 44.9 | 71.3 | 0.15 / 2.5 | Yes |

| GPT-5 | 128K | ~40 | ~65 | 3 / 15 | No |

| Claude Sonnet 4.5 | 200K | 42 | 68 | 3 / 15 | No |

| Gemini 2.5 Pro | 1M+ | 38 | 62 | ~2 / 10 | No |

KIMI의 강점: 비용 1/10, 오픈소스, agentic 성능. 단, 속도가 약간 느림.

장단점 & 실제 사용자 리뷰 (Reddit/X)

장점:

- 인간다운 글쓰기: "Claude처럼 자연스럽다" (Reddit)

- 코딩 전문가: 버그 수정·전체 앱 빌드 OK

- 비용 효율: 무료 웹 + 저가 API

- 에이전트 안정성: 300 tool call 무 Drift

단점:

- 초기 토큰 지연: 2~3배 느림

- 서버 과부하: 피크타임 대기

- 멀티모달 약함: 텍스트 중심

사용자 목소리:

"Kimi K2 Thinking으로 4시간 코드 리팩토링. 다른 모델은 포기했는데 이건 해냄!" – X 사용자

"Reddit에서 '코딩 에이전트 최고' 소리 듣는 이유 알겠음. human-like하고 안정적." – r/LocalLLaMA

마무리: KIMI AI로 생산성 10배 높이기

KIMI AI는 단순 챗봇이 아니다. reasoning agent로 미래를 보여준다. 오늘 kimi.moonshot.cn에서 시작해 보자. 로컬 실행으로 프라이버시 지키며, API로 앱에 통합. 중국 AI의 물결이 온다 – 당신의 워크플로우를 바꿀 때다.

질문 있나? 댓글로! 다음 글에서 Kimi로 실제 프로젝트 빌드 해보자.